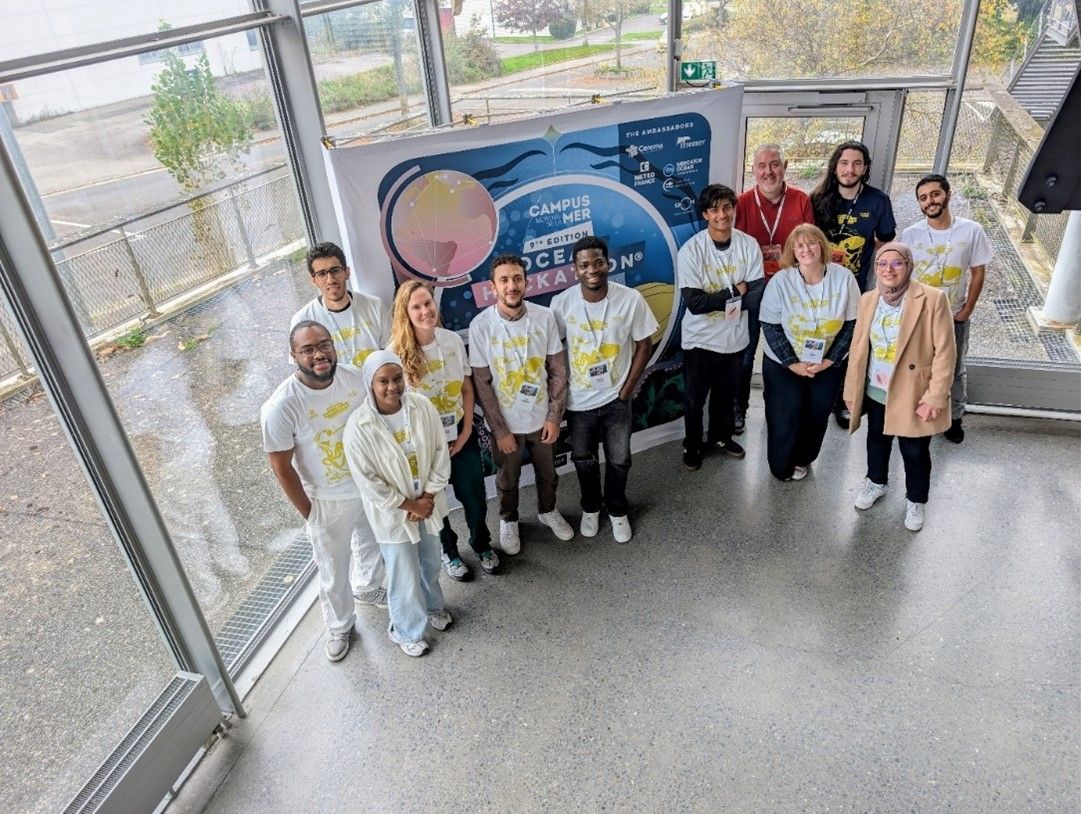

Du 17 au 19 octobre 2025, l’équipe BRE04 a fièrement représenté ISEN Ouest (Yncréa) lors de la 9ᵉ édition de l’Ocean Hackathon®, organisée par le Campus Mondial de la Mer et la Technopole Brest-Iroise à l’ENIB.

Sous la houlette de Thibault Napoléon et Matthieu Saumard, le défi « Voice in the Blue » a embarqué une équipe passionnée pour 48 heures d’innovation autour d’un même objectif : donner une voix à l’océan.

Un constat alarmant… et une opportunité bleue

Le projet est né d’un double constat :

-Nous connaissons mieux la surface de la Lune que les fonds marins profonds.

-L’exploration par intelligence artificielle (IA) et robots autonomes reste limitée par le manque de jeux de données annotés sous-marins, pourtant indispensables à l’entraînement des modèles d’IA.

Face à cela, le projet Voice in the Blue propose une idée audacieuse : impliquer les plongeurs eux-mêmes dans la création de ces données. En enregistrant leur voix pendant l’observation, ils peuvent décrire ce qu’ils voient — poissons, coraux, plongeurs — et ainsi annoter en temps réel les images sous-marines.

Une approche technique novatrice : la segmentation par la voix

Le cœur du défi réside dans le développement d’un système capable d’exploiter à la fois les images et les descriptions vocales pour améliorer la segmentation sémantique des scènes sous-marines.

Deux étapes clés structurent cette approche :

- Étape 1 — Annotation/Génération : à partir d’un jeu de données existant (type SUIM dataset), un fichier audio simulant la description du plongeur est généré pour chaque image annotée.

- Étape 2 — Segmentation IA : l’algorithme prend en entrée l’image brute et le fichier audio descriptif, puis produit une segmentation en huit classes (poisson, corail, plongeur, sable, etc.).

Ce concept ouvre la voie à une nouvelle génération de datasets intelligents, co-créés par l’humain et la machine.

Un immense merci aux organisateurs, aux coachs et à tous les participants de cette 9ᵉ édition pour leur énergie et leur esprit d’équipe.Cette expérience restera une belle aventure humaine et scientifique, inscrite dans la continuité du projet ANR CESAR, dédié à la vulgarisation et à la valorisation de la recherche marine.